Aplicación de Rigging y Animación 3D: Bitácora Definitiva de mi Primer Cortometraje en Blender

Resumen:

Este artículo es una bitácora exhaustiva, detallada y sin filtros sobre cómo logré planificar, ensamblar, texturizar, aplicar rigging avanzado, animar y renderizar un cortometraje animado de un minuto de duración utilizando exclusivamente Blender, el titán del software de código abierto.

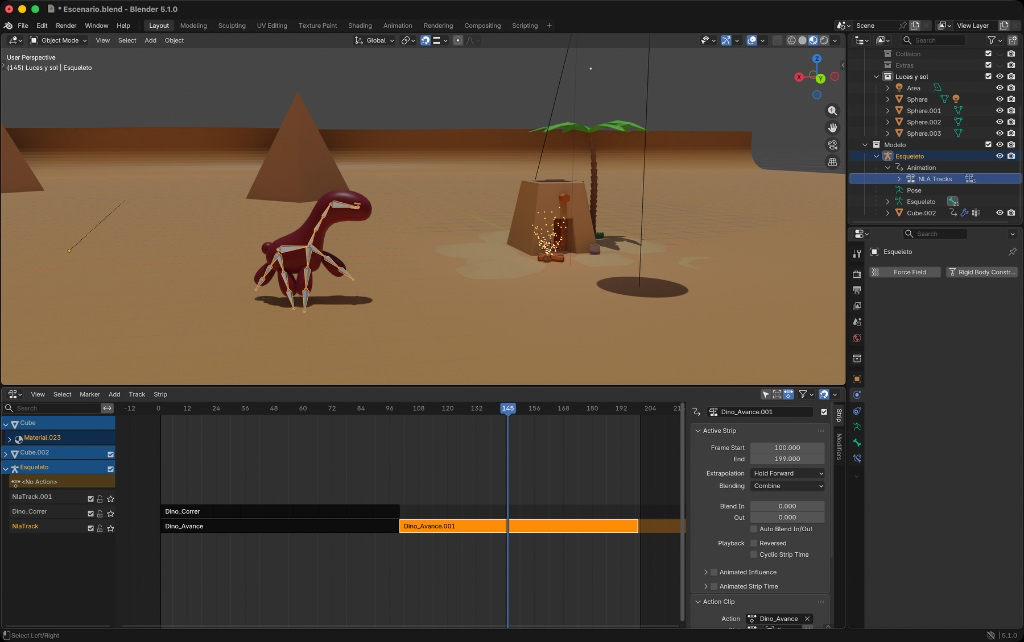

Si alguna vez han abierto este programa y se han sentido abrumados por la infinidad de menús, paneles de propiedades y atajos de teclado, este post es su salvavidas técnico. A lo largo de estas extensas páginas documentaré cómo creé un escenario desértico nocturno donde un intrépido dinosaurio esquiva obstáculos. Profundizaremos en la médula espinal del 3D: la teoría de aplicación de rigging (creación de esqueletos digitales y cinemática), cómo optimizar tiempos usando modelos preexistentes, la magia matemática de agrupar animaciones en el Editor No Lineal (NLA) y la aplicación de modificadores algorítmicos. Además, detallaré los conceptos de texturizado Physically Based Rendering(PBR), la configuración fotométrica de la iluminación, y el comportamiento de físicas newtonianas para sistemas de partículas.

Introducción: El Sueño del Cineasta Indie y la Democratización del 3D 🎬

Hace apenas una década, la animación 3D de alta calidad era un arte arcano, una “magia negra” reservada exclusivamente para los pasillos de Pixar, DreamWorks o Industrial Light & Magic. Requería granjas de renderizado del tamaño de un edificio comercial y licencias de software privativo que costaban decenas de miles de dólares por asiento. Sin embargo, la evolución sostenida de Blender ha democratizado esta industria a niveles históricos. Como señala la documentación oficial de la Blender Foundation (2024), hoy en día tenemos en nuestra computadora personal un pipeline o tubería de producción audiovisual completa. Podemos modelar, esculpir, aplicar rigging, animar, simular fluidos, componer y editar video en una sola interfaz, rivalizando directamente con los estándares de la gran industria.

Objetivos:

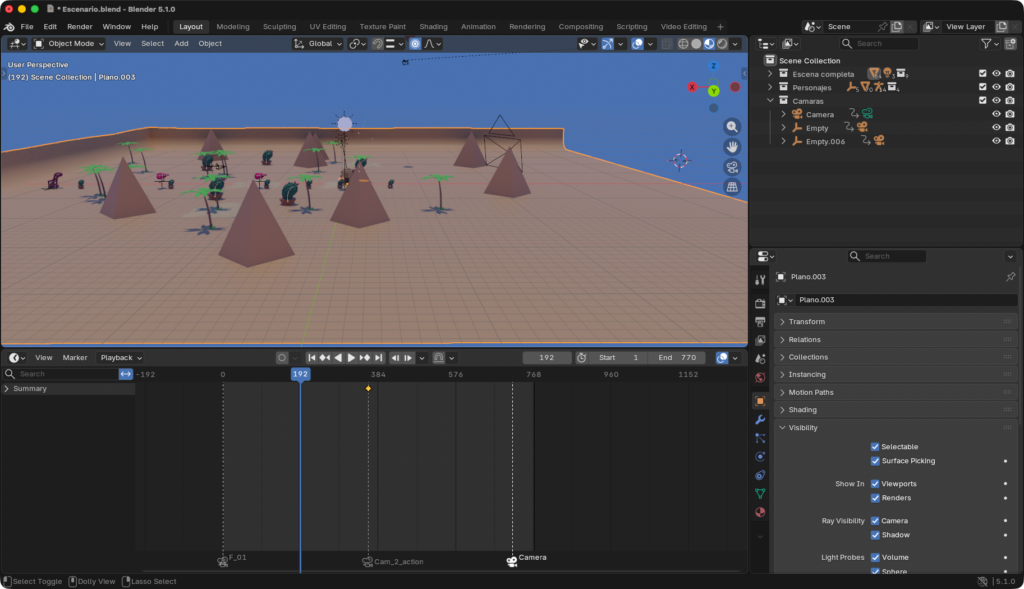

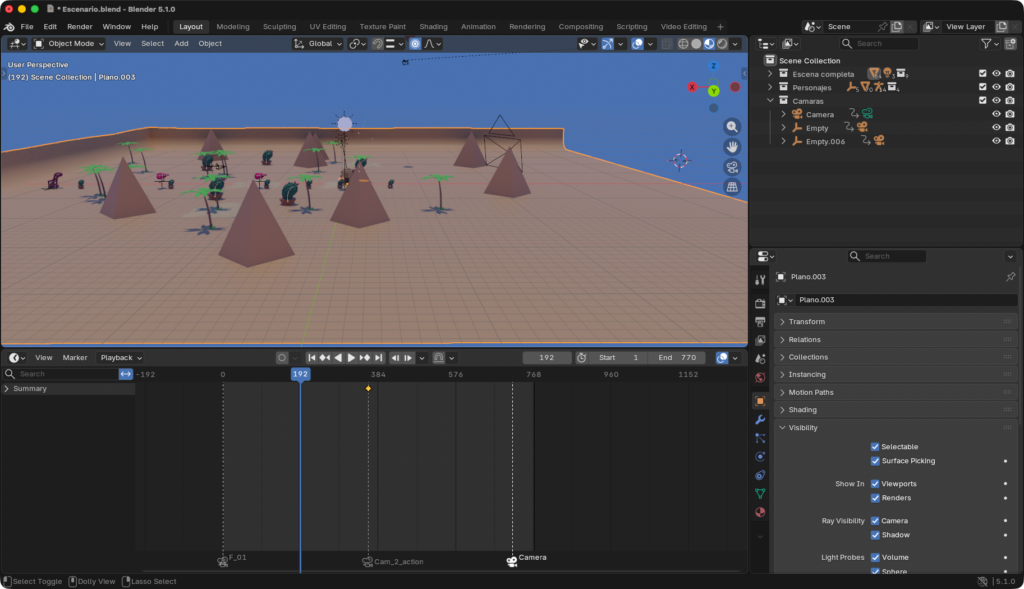

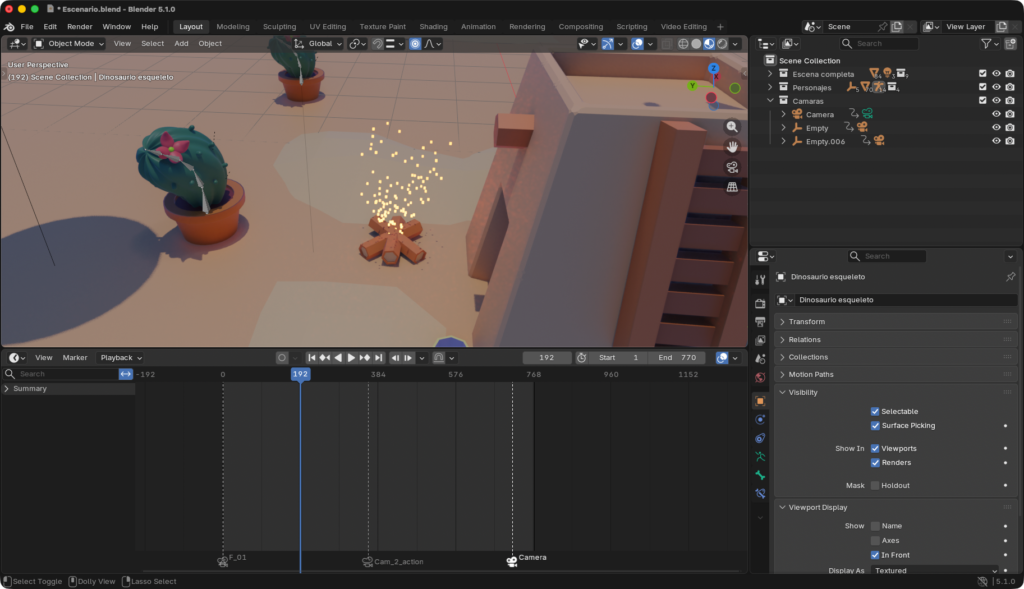

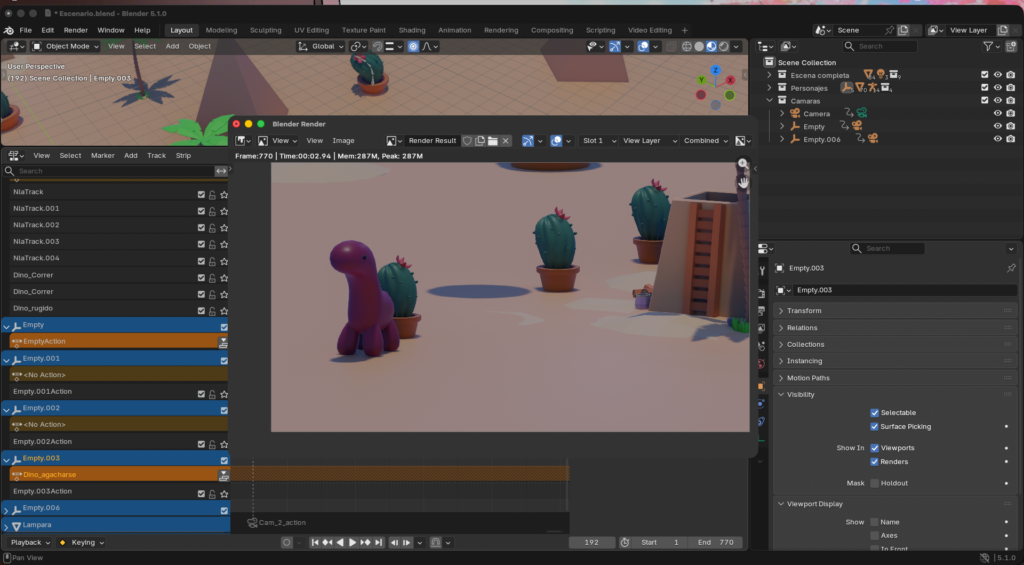

Mi objetivo para este proyecto era claro, pero altamente ambicioso para un animador trabajando en solitario: crear una secuencia audiovisual fluida e ininterrumpida de exactamente 60 segundos. Corriendo a una tasa de fotogramas estándar de la industria cinematográfica (24 fotogramas por segundo o FPS), esto se traduce en 770 frames individuales que la CPU y la GPU deben calcular píxel por píxel. La premisa narrativa es directa pero efectiva: un dinosaurio corriendo a través de un desierto implacable bajo la luz de las estrellas, saltando sobre cactus y sorteando un entorno hostil.

Aquí va mi primer consejo de supervivencia en este diario: trabajen de forma inteligente y modular, no pesada. La industria actual valora enormemente la capacidad de iterar y componer escenas rápidamente (kitbashing). Si hubiera invertido seis meses en modelar cada púa de los cactus y en esculpir cada escama del dinosaurio a mano, el proyecto habría fracasado por agotamiento prematuro. Por ello, decidí enfocar todos mis esfuerzos cognitivos en las áreas que realmente elevan una obra de amateur a profesional: la aplicación de rigging para el control de la deformación, la dirección cinematográfica multicámara, el manejo de curvas de animación y los sistemas de partículas dinámicos.

Preproducción: Cazando Recursos, Formatos y la Superioridad del glTF ☁️

Antes de enfrentarme al temido cubo predeterminado de Blender, necesité armar mi “caja de juguetes”. En el cine live-action, esto equivale a la ardua etapa de scouting (búsqueda de locaciones) y casting de actores. En nuestro ecosistema digital, es la etapa de curaduría, selección y descarga de assets.

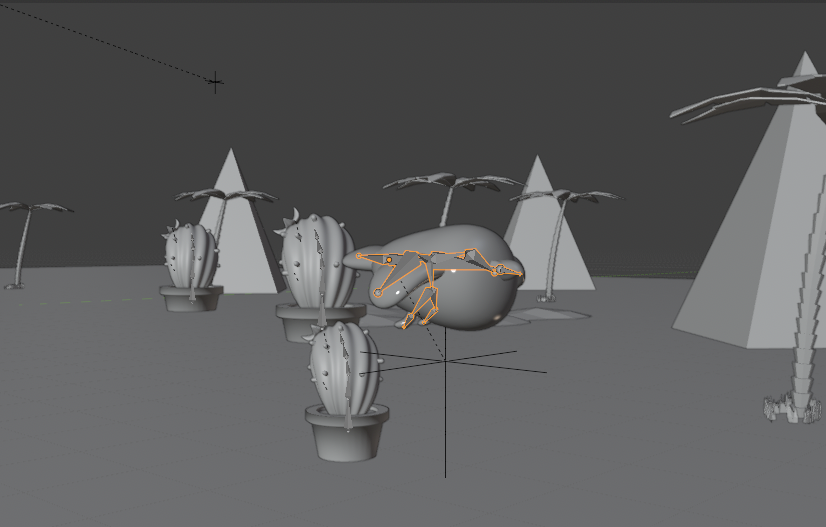

El Escenario Base y la Arquitectura de los Formatos 3D

Para poblar mi vasto desierto, recurrí a la inmensa biblioteca comunitaria de Sketchfab. El pilar estructural de mi proyecto fue un entorno pre-hecho llamado Low poly desert with animation ([Nombre del Autor del Desierto], 2024). Este modelo me brindó una base atmosférica nocturna hermosa, con una topografía irregular rica en polígonos, montañas asimétricas en el horizonte y una pintoresca casa de estilo rústico que serviría más adelante como mi principal punto de interés lumínico.

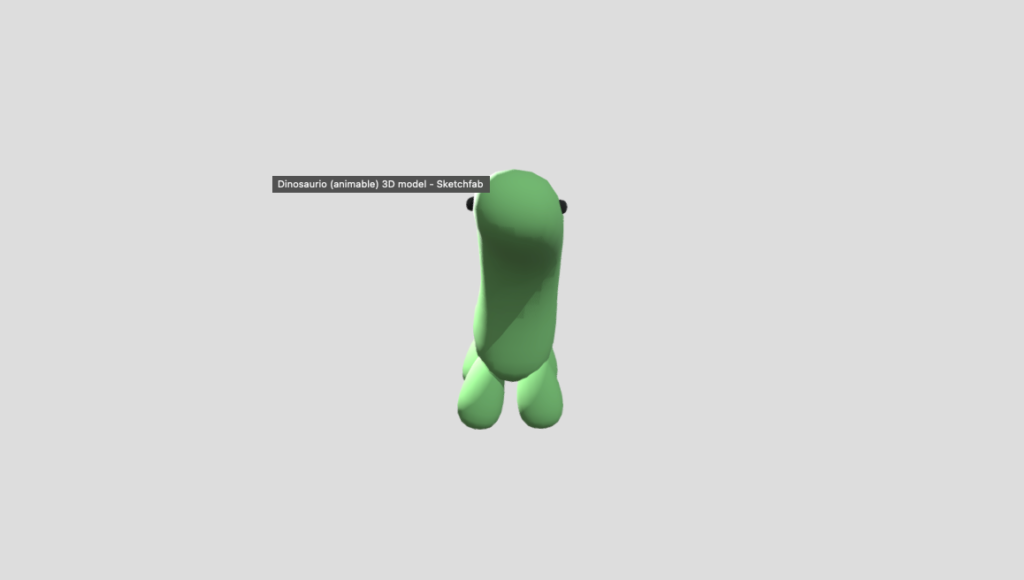

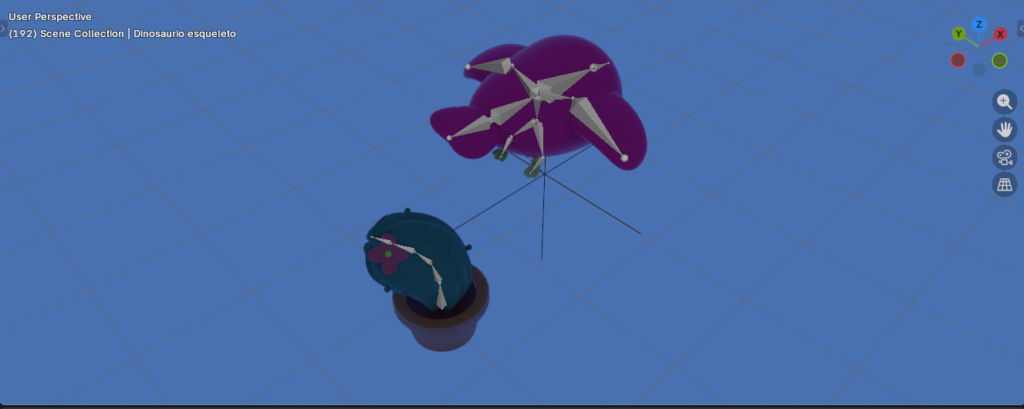

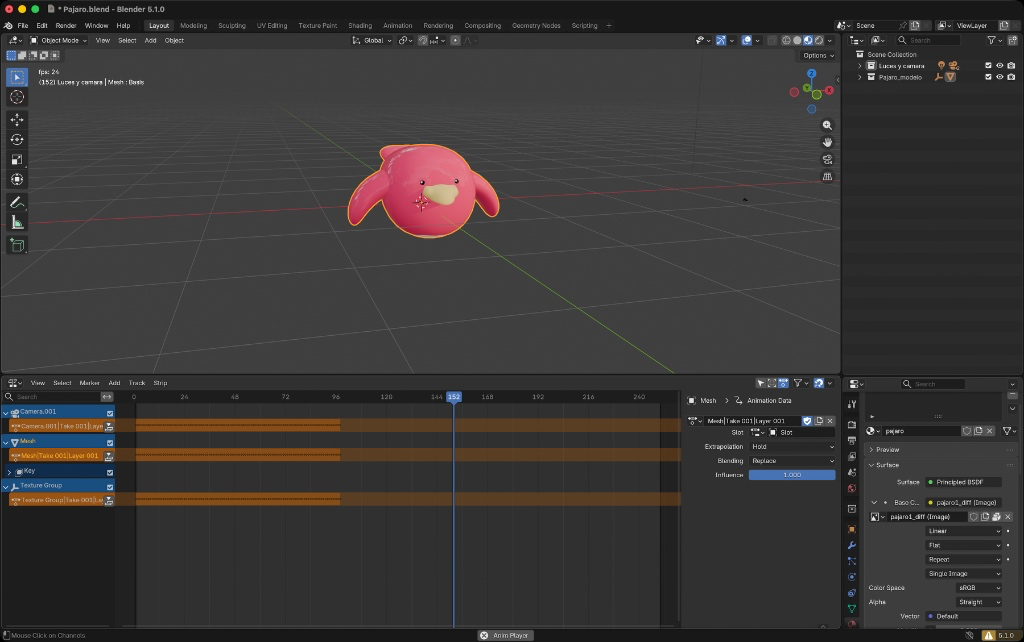

Sobre este escenario, introduje a mi protagonista absoluto: un modelo de un Dinosaurio Animable (Gatito, 2024). Elegí este modelo específicamente porque su malla base (la topología de sus polígonos) estaba construida estrictamente con quads (polígonos de cuatro lados). En la teoría del 3D, los quads son matemáticamente ideales porque permiten que el modelo se doble y se deforme en las articulaciones sin crear pinching (pliegues feos o sombras rotas), algo que suele ocurrir cuando se usan triángulos (tris). Para darle escala y un toque de vida al cielo nocturno, descargué un modelo de un Pájaro detallado (Design factory, 2024).

El secreto técnico de los formatos

En mis inicios solía descargar modelos en formato .OBJ. Sin embargo, esto es un error logístico grave en proyectos grandes. El formato .OBJ es un estándar muy antiguo (desarrollado por Wavefront Technologies) que solo almacena las coordenadas de los vértices y la geometría plana; las texturas se guardan en un archivo .MTL separado que a menudo pierde la ruta, obligándote a rearmar los materiales nodo por nodo en Blender.

Para este proyecto, busqué exclusivamente archivos .glTF (GL Transmission Format) o .FBX. El formato .glTF ha sido bautizado como el “JPEG del 3D” por el Grupo Khronos. Su magia radica en que empaqueta no solo la malla geométrica, sino todo el sistema de materiales PBR (Color base, Mapas de Normales para el relieve, y Mapas de Rugosidad) directamente en un solo archivo basado en JSON o binario. Esto garantiza que, al arrastrarlo a Blender, el modelo se vea exactamente igual que en el previsualizador de la página web.

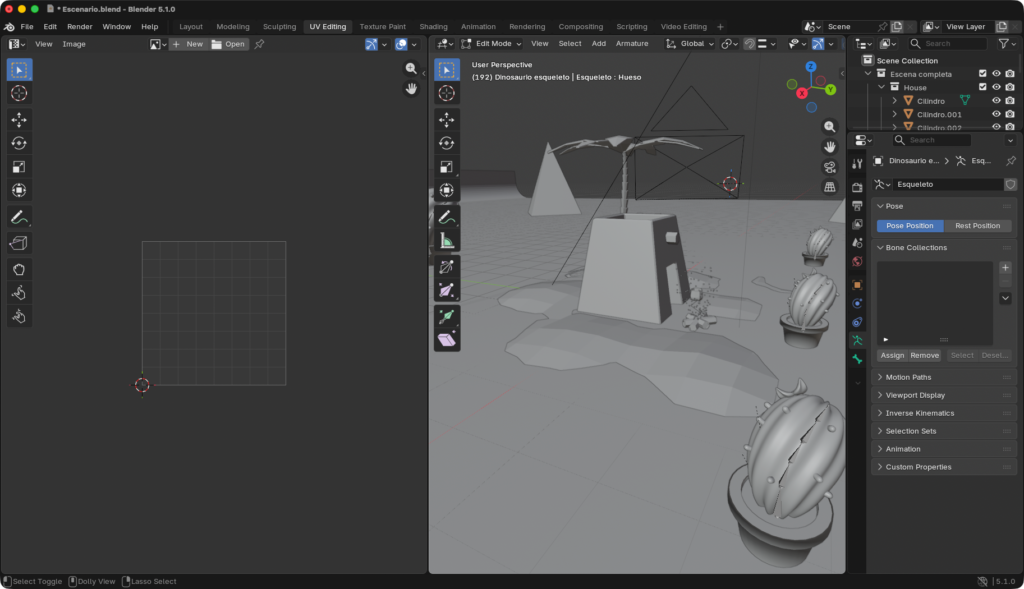

Aplicación de Rigging: Cinemática, Esqueletos y Pintura de Pesos (Weight Painting)

Tener un modelo 3D con texturas de alta resolución es inútil para un animador si no se puede mover; es esencialmente un hermoso trozo de arcilla congelado en el espacio. Aquí es donde entra la fase más crítica de mi proyecto: la Aplicación de Rigging. El rigging es el proceso de dotar a una malla 3D de un esqueleto digital, jerarquías y controles articulados.

Para este proyecto, implementé un flujo de trabajo híbrido de rigging, combinando métodos manuales y algorítmicos.

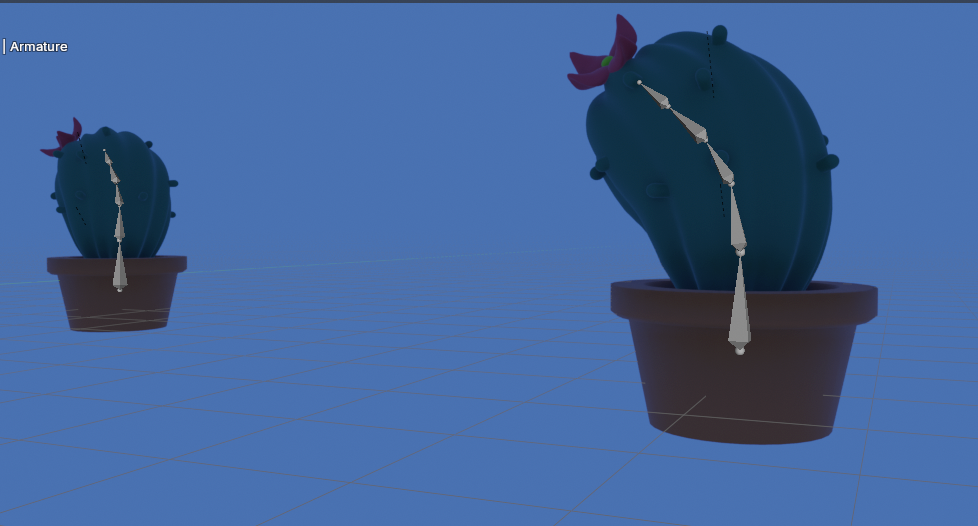

Rigging Manual para el Entorno:

Para elementos del escenario y ciertos objetos secundarios (como el pájaro o los cactus móviles), creé esqueletos (armatures) desde cero. El proceso en Blender implica presionar Shift + A > Armature, lo que genera un “hueso base” (Root bone). Entrando en el Modo Edición (Tab), utilicé la herramienta de extrusión (E) desde la punta del hueso para crear una cadena cinemática continua que siguiera la anatomía del modelo (alas, tallos, etc.). La magia ocurre en el emparentamiento (Ctrl + P > With Automatic Weights). Al ejecutar este comando, Blender calcula un algoritmo volumétrico llamado Weight Painting (Pintura de Pesos). El software asigna un valor de influencia que va de 0.0 (azul oscuro, ninguna influencia) a 1.0 (rojo intenso, influencia total). Así, cuando roto el hueso del “ala” en Modo Pose, los vértices que están pintados de rojo alrededor de ese hueso se mueven al unísono, mientras que los azules se quedan quietos.

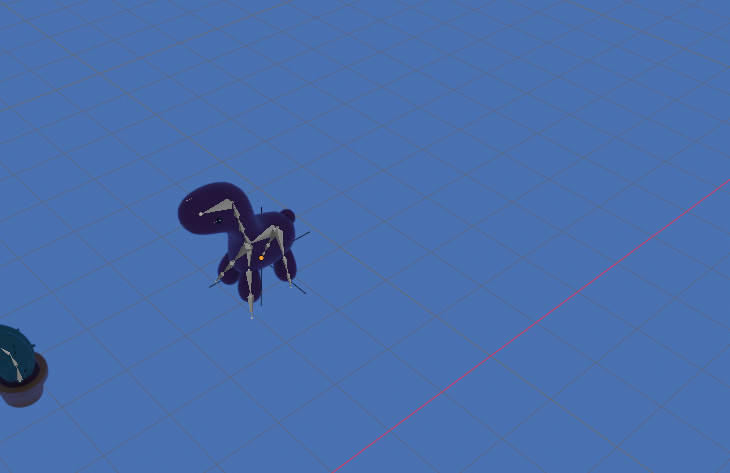

Rigging Algorítmico y Cinemática para el Dinosaurio: Para mi dinosaurio protagonista, esculpir los pesos de cada garra y vértebra manualmente habría tomado semanas. Aproveché la Inteligencia Artificial de Mixamo (Adobe Systems, s.f.). Subí mi modelo y utilicé su herramienta de Auto-Rigger. Mediante la colocación de marcadores espaciales simétricos en las muñecas, codos, rodillas y barbilla del personaje, el algoritmo de Adobe calculó una jerarquía de huesos perfecta en segundos. De allí, extraje los datos de animación en formato .FBX para las complejas acciones de “Correr” y “Saltar”. Estas animaciones utilizan lo que se conoce como Forward Kinematics (Cinemática Directa) para la espina dorsal y Inverse Kinematics (Cinemática Inversa) para que los pies se anclen solidamente al suelo durante la carrera.

Diseño Sonoro y el Estudio de Referencias

La animación no existe en el vacío; requiere un pulso, un ritmo. Para dictar los cortes de cámara y el ritmo (el timing) del salto de mi dinosaurio, utilicé una versión remezclada del tema clásico de Tetris ([Nombre del Canal de Tetris], 2024). Las notas rápidas en formato de 8-bits y su compás acelerado encajaban perfectamente con la temática de supervivencia veloz.

Además, para entender cómo estructurar los movimientos de cámara y no desorientar al espectador (un error fatal en 3D), estudié profundamente el ritmo del montaje en ensayos de YouTube ([Nombre del Canal del Video 1], 2024; 2024). Estos recursos me enseñaron la aplicación estricta de la “Regla de los 180 grados” (mantener las cámaras de un solo lado del eje de acción para que el dinosaurio siempre corra de izquierda a derecha) y la importancia de guiar el ojo del espectador dejándole espacio en la pantalla hacia donde se dirige la mirada del personaje.

Ensamblaje, Modificadores Algorítmicos y Partículas Físicas 🎨✨

Con la preproducción estructurada, el verdadero desafío comenzó en el espacio de trabajo Layout de Blender. Importar decenas de objetos requiere una gestión rigurosa de coordenadas matemáticas (locales vs. globales).

Texturizado PBR y el Algoritmo Catmull-Clark (Modificadores)

A diferencia del hiperrealismo abrumador que buscan producciones de alto presupuesto, yo me decanté por una estética estilizada, reminiscente a un “juguete físico” o claymation (animación con plastilina). Para lograr esto, texturicé los modelos utilizando el nodo Principled BSDF.

Entrando en la pestaña de Materiales (Shader Editor), creé Slots nuevos y asigne colores sólidos en el canal Base Color(el Albedo). El truco visual radicó en elevar deliberadamente el valor del canal Roughness (Rugosidad) por encima de 0.8. En la teoría de la luz (PBR – Physically Based Rendering), una superficie con rugosidad alta presenta imperfecciones a nivel microscópico que dispersan los rayos de luz de forma caótica (difusión). Esto elimina los brillos especulares (los reflejos tipo “espejo” o “plástico brillante”) y otorga ese codiciado aspecto mate.

Sin embargo, un buen material PBR no salva una malla de baja resolución (Low Poly) si no es tu intención artística. Para que los modelos orgánicos de mi escena no mostraran bordes poligonales afilados ante la cámara de cerca, recurrí a los Modificadores, que son potentes operaciones matemáticas no destructivas. En el panel de propiedades, utilicé el modificador Subdivision Surface. Este modificador emplea el famoso algoritmo matemático de Catmull-Clark (creado por los fundadores de Pixar y Silicon Graphics) para dividir cada cara cuadrada en cuatro caras más pequeñas, calculando el baricentro de los vértices y creando una superficie orgánicamente curva en tiempo real. Para los objetos arquitectónicos, como la casa del fondo, apliqué el modificador Bevel (Biselado), que redondea micro-milimétricamente los ángulos de 90 grados, permitiendo que la luz atrape los bordes (edge highlights) de forma sumamente realista.

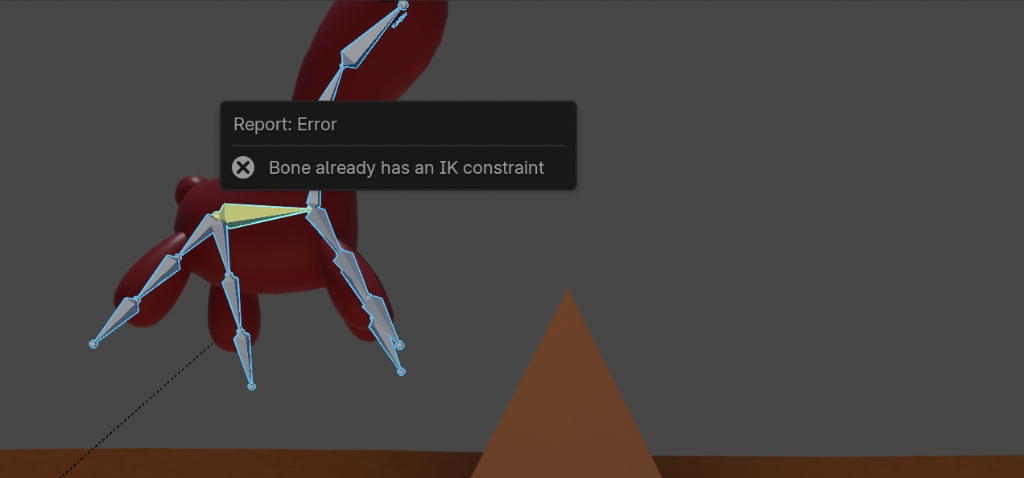

La Física del Desastre: Sobreviviendo a la “Explosión de Vértices”

Durante la etapa de vinculación del rigging, me enfrenté al terror número uno de los animadores técnicos. Al intentar emparentar el esqueleto que había creado a la malla de un modelo importado, la geometría colapsó catastróficamente: los vértices salieron disparados en líneas rectas y afiladas hacia el infinito de la cuadrícula 3D, deformando al personaje hasta dejarlo como una masa de espinas incomprensible.

La explicación algorítmica y la cura: Este fallo crítico ocurre por un conflicto severo entre las coordenadas locales de la malla y el espacio global de la escena. Si el creador original del modelo en Sketchfab redujo el tamaño del objeto (por ejemplo, a una escala de X: 0.5, Y: 0.5, Z: 0.5), pero nunca le indicó al software que ese nuevo tamaño era su estado fundamental, Blender sigue almacenando esa matriz de escala. Al aplicar el esqueleto (el cual se genera con una escala prístina de 1.0), el motor matemático multiplica los pesos de los vértices por matrices conflictivas, destrozando la geometría.

Para purgar este error, la solución fue clínica:

- Seleccioné la malla rota, presioné

Alt + P > Clear Parentpara romper el vínculo de parentesco. - Seleccioné la malla aislada y utilicé el comando más vital en el modelado 3D:

Ctrl + A > All Transforms(Aplicar todas las transformaciones). - Este comando sobreescribe los datos del objeto, forzando a que su tamaño actual se convierta en la escala absoluta

1.0, 1.0, 1.0y su rotación sea0º, 0º, 0ºa nivel de código interno. - Tras limpiar matemáticamente tanto la malla como el esqueleto, volví a vincularlos (

Ctrl + P > With Automatic Weights). La explosión desapareció instantáneamente, permitiendo una flexión orgánica impecable.

Configurando la Fotometría: El Sol y la Temperatura de Color

Para resaltar mis texturas mate y volumetrías, la iluminación ambiental plana y grisácea que Blender trae por defecto era inaceptable. Necesitaba luz direccional y sombras duras de alto contraste.

Configuré un objeto de luz de tipo Sol (Sun) (Shift + A > Light > Sun). A diferencia de una lámpara de punto (Point Light) cuya intensidad decae rápidamente con la distancia siguiendo la ley de la inversa del cuadrado, el objeto Sun en el entorno 3D omite la distancia física; emite rayos de luz perfectamente paralelos a lo largo de toda la escena en un solo vector angular, simulando fielmente cómo la luz de nuestra estrella llega a la Tierra.

Roté los ejes del Sol para lograr un ángulo sumamente rasante (casi horizontal a la arena), generando sombras kilométricas y dramáticas, típicas de un atardecer en el desierto. En sus propiedades fotométricas, ajusté la Strength(Emisión de fuerza) a 5.0 y, utilizando la escala de Kelvin, le asigné una temperatura de color cálida (alrededor de 2500K a 3000K, un tono fuertemente anaranjado) para acentuar el dramatismo y separar al dinosaurio del fondo oscuro.

Físicas Newtonianas: El Sistema de Partículas para la Lámpara

El escenario arquitectónico incluía una casa, pero esta se percibía estática, casi sin vida. Decidí utilizar el robusto motor de físicas integrado de Blender para crear un sistema de partículas para la lámpara exterior y simular un enjambre dinámico de luciérnagas o chispas voladoras.

El desglose técnico fue el siguiente:

- Creé un objeto de malla básico (una esfera minúscula) y la oculté a la cámara, posicionándola flotando justo dentro de la bombilla de cristal de la lámpara.

- Fui a la pestaña de Particle Properties y añadí un sistema emisor (Emitter).

- Entrando en los cálculos de físicas Newtonianas del panel, configuré un Lifetime (vida útil) de apenas 40 fotogramas. Esto significa que cada partícula nace, existe durante menos de dos segundos, y desaparece, asegurando una renovación constante.

- El paso maestro fue ir a la sección de Field Weights (Pesos de campo) y reducir la influencia de la Gravedad al 0%. Si no hacía esto, las partículas simplemente caerían al suelo en línea recta respondiendo a la constante de -9.8 m/s². Al anular la gravedad, las partículas quedan suspendidas en microgravedad.

- Para dotarlas de un movimiento orgánico (similar al movimiento browniano de los insectos), agregué un Force Field (Campo de Fuerza) de tipo Turbulence. Ajusté el tamaño del ruido espacial (Noise Scale) para que el campo empujara y arrastrara las partículas suavemente en espirales aleatorias.

- Finalmente, en la pestaña Render del sistema, le indiqué que en lugar de renderizar “halos”, instanciara un objeto 3D real (una pequeña icosfera) al cual le había aplicado un material Emission (Emisivo) de un amarillo cegador (Fuerza 15.0).

El resultado fue profundamente inmersivo: un enjambre de puntos de luz revoloteando caóticamente, iluminando su entorno inmediato y dotando a la escena nocturna de una escala y calidez abrumadoras.

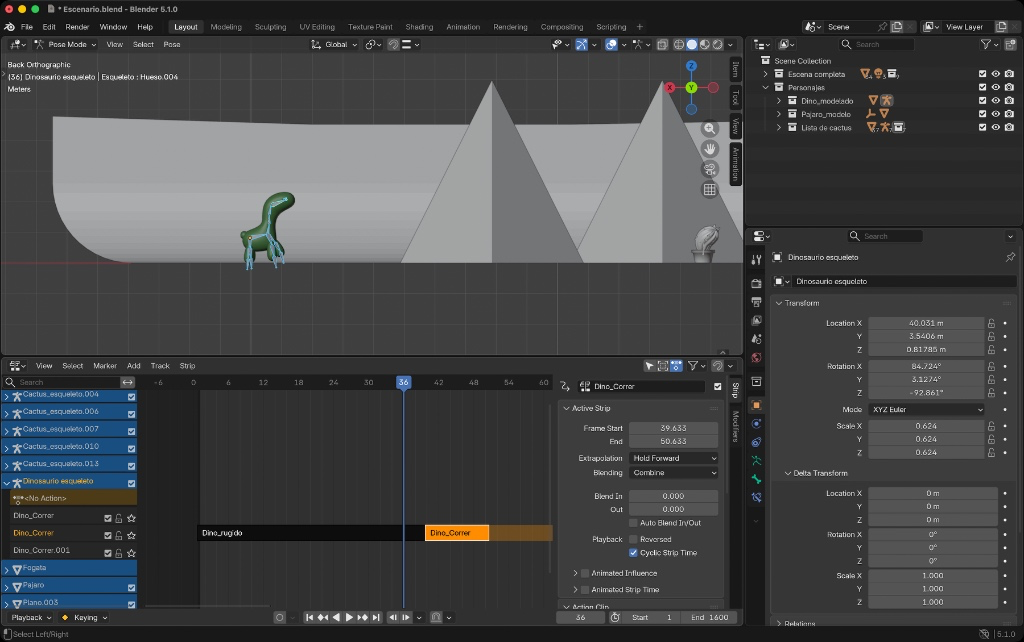

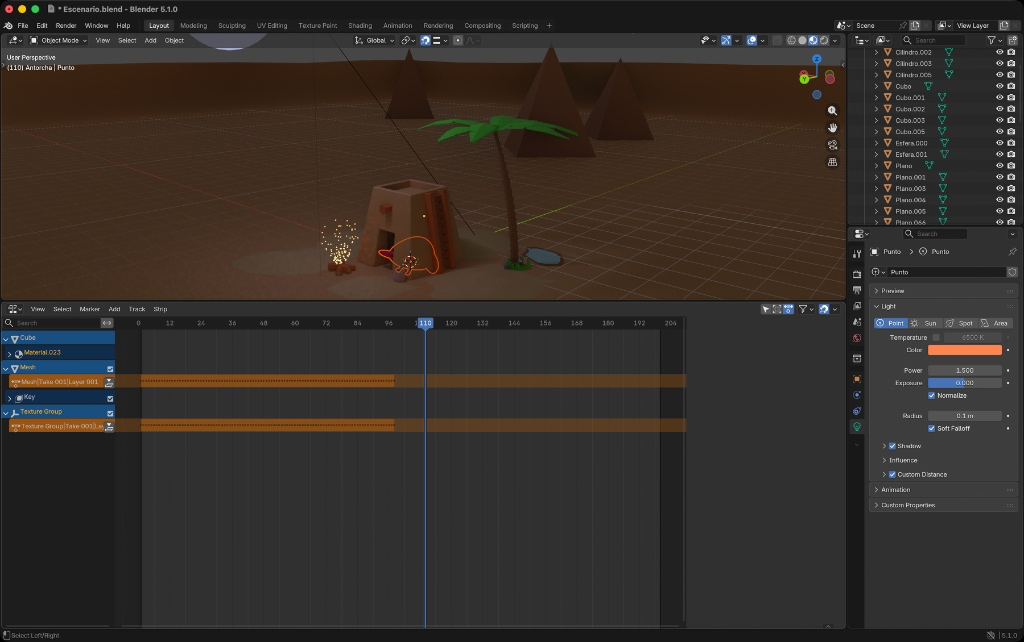

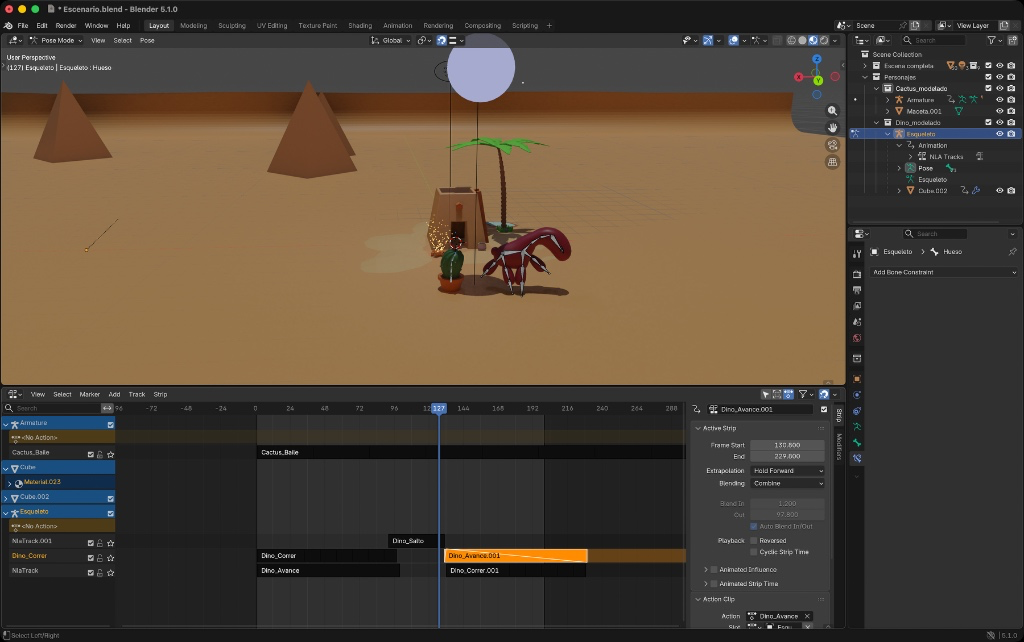

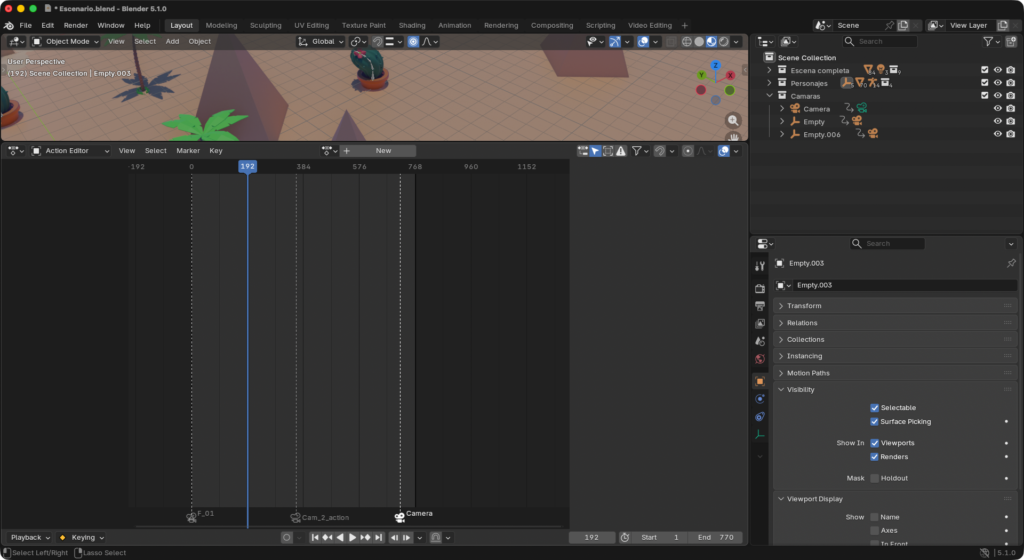

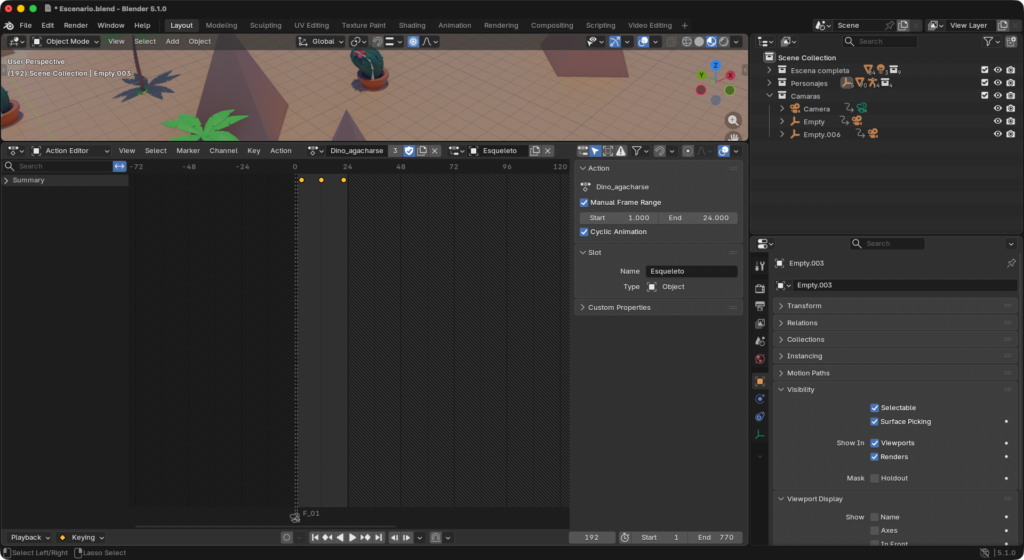

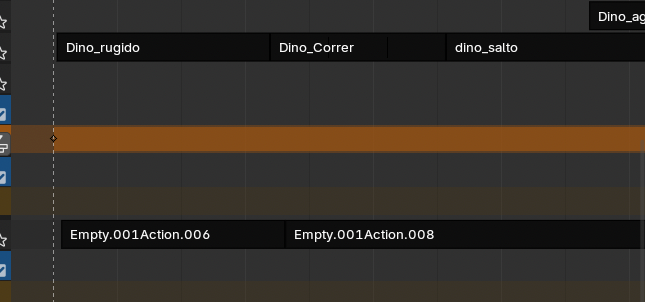

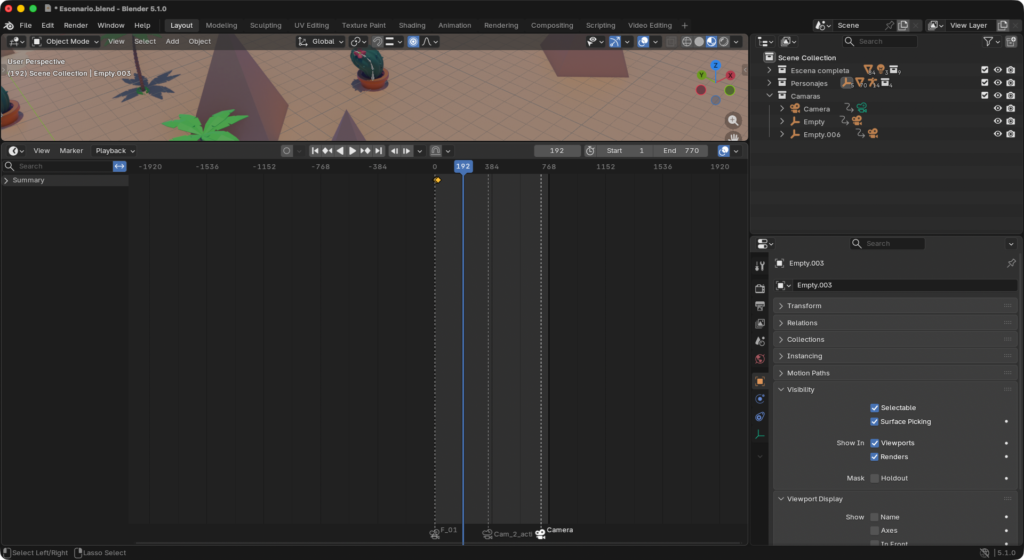

Orquestación Temporal: El NLA Editor y la Curvatura del Graph Editor 📉

Un desafío algorítmico mayúsculo surgió al intentar que mi dinosaurio dejara de ejecutar su ciclo de correr, pasara a saltar un obstáculo, y luego retomara la carrera sin perder momentum. Las animaciones puras basadas en fotogramas clave (keyframes) se sobreescribían violentamente, creando tirones y roturas de huesos (los glitches visuales).

Para orquestar este ballet como un director musical, empleé el Non-Linear Animation Editor (NLA). Esta interfaz avanzada me permitió convertir mis complejas pistas de animación lineales en “Tiras de Acción” (Action Strips) empaquetadas. Al encapsular el ciclo de carrera y el de salto en bloques sólidos (similar a los clips de video en un editor tradicional como Premiere Pro), pude superponerlos en capas. Blender utiliza aquí una función algorítmica de Auto Blending (Mezcla Automática) que interpola matemáticamente los cuaterniones de rotación de los huesos, creando una transición fluida entre el último fotograma de la carrera y el primer fotograma del agachamiento para el salto.

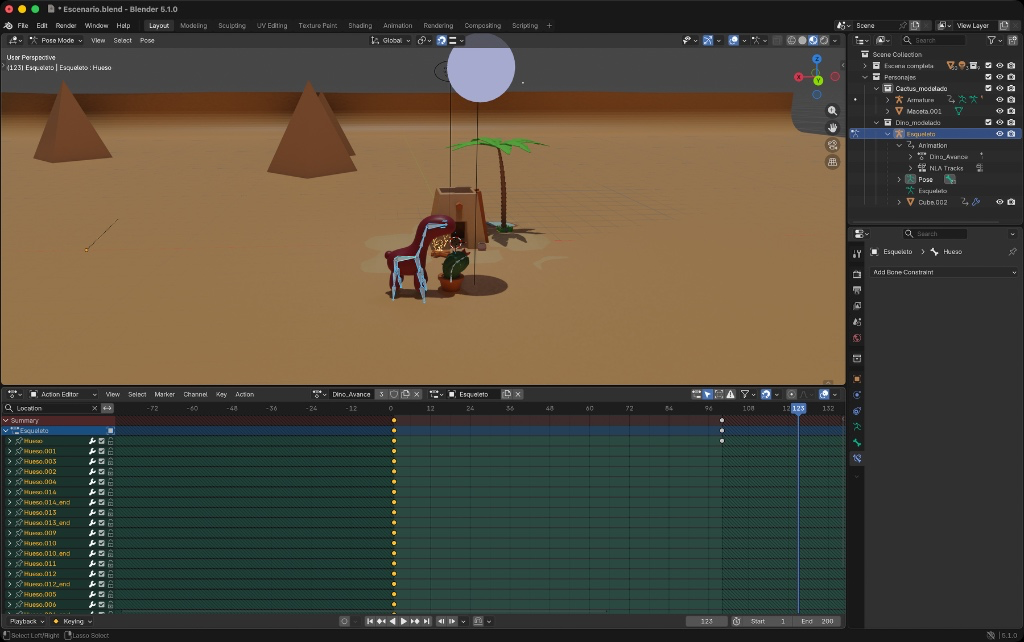

Retos

No obstante, me topé con un error de coordenadas derivado de la captura de movimiento original: al ejecutarse el bloque de salto, el dinosaurio se teletransportaba mágicamente a 3 metros de altura, ejecutaba todo el salto suspendido en el vacío, y caía de golpe para seguir corriendo.

Para someter a la máquina, recurrí al corazón absoluto de la animación 3D: el Graph Editor (Editor de Gráficos). A diferencia de la línea de tiempo tradicional, el Graph Editor no muestra una serie de puntos, sino curvas de Bézier matemáticas que representan el cambio de un valor a través del tiempo. Seleccioné la tira del salto, desplegué la jerarquía del esqueleto y localicé el canal Z Location (la posición vertical) del hueso de la cadera (Root/Hips). La curva verde en mi pantalla ilustraba vívidamente el problema: toda la gráfica de la parábola del salto estaba desfasada en el eje Y (valores positivos). Presioné A para seleccionar todos los keyframes de la curva. Presioné G (Comando Mover) seguido inmediatamente de Y (para restringir el desplazamiento estrictamente al eje de los valores y evitar mover los puntos en el tiempo, lo cual habría desincronizado la animación). Deslicé minuciosamente toda la gráfica hacia abajo hasta que el valle más bajo de la curva tocó exactamente el valor 0.00 (el nivel del suelo). El salto del dinosaurio quedó físicamente anclado a la arena de forma perpetua.

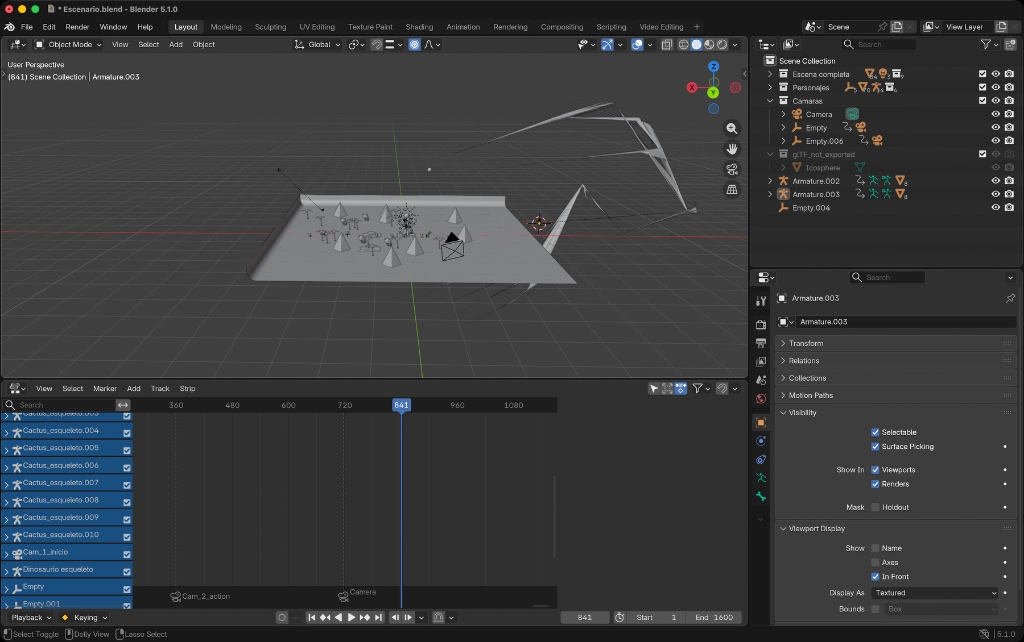

Locomoción: Evitando el “Moonwalk” con el Paradigma de la “Cinta de Correr” 🏃♂️

El error más delator y antiestético en las animaciones de creadores principiantes es el “deslizamiento de pies” (conocido como efecto foot sliding o moonwalk). Ocurre cuando el personaje avanza por el espacio 3D más rápido, o más lento, de lo que sus piernas ejecutan el paso, dando la impresión de que está patinando sobre hielo infinito.

Sincronizar a mano la traslación espacial de un personaje con la longitud exacta de su zancada es un infierno de microgestión. Para eludir este suplicio y garantizar una locomoción fotorrealista, implementé el paradigma que en la industria se conoce como el truco del objeto nulo o la “Cinta de Correr”.

- Creé un objeto nulo o Empty (

Shift + A > Empty > Plain Axes). Un Empty es una abstracción matemática; existe en el espacio, tiene coordenadas, pero es invisible en el render final. Lo posicioné exactamente entre los pies del dinosaurio. - Emparenté el esqueleto principal (el Rig) a este Empty (

Ctrl + P > Object). El Empty se convirtió en el “vehículo” del dinosaurio. - Dejé la animación de carrera del dinosaurio reproduciéndose in-place (corriendo en el mismo sitio, sin moverse en el eje coordenado global).

- El trabajo arduo de desplazamiento se lo delegué íntegramente al Empty. Inserté un keyframe de posición para el Empty en el inicio del desierto (Fotograma 1), me desplacé al Fotograma 1440, moví el Empty a 100 metros de distancia atravesando todo el mapa, e inserté el segundo keyframe.

La matemática vital de la interpolación

Por defecto, las curvas de animación espaciales en Blender utilizan la función de interpolación de Bézier. Esto significa que cualquier objeto en movimiento acelera suavemente desde cero, alcanza su velocidad máxima de crucero en el medio, y desacelera (frena) suavemente al acercarse a su destino. Si lo dejaba así, las piernas de mi dinosaurio se moverían a una velocidad constante, pero el cuerpo aceleraría y frenaría, causando un resbalamiento masivo en los pies en el primer y último cuarto del cortometraje. Para forzar a la máquina a obedecer, seleccioné ambos keyframes del Empty en la línea de tiempo, presioné T (menú de Interpolación) y sobrescribí la función matemática cambiando a interpolación Linear (Lineal). Esto instruyó al software a calcular un vector de desplazamiento de velocidad absoluta y constante, acoplándose milimétricamente al ritmo estricto y repetitivo del ciclo de carrera.

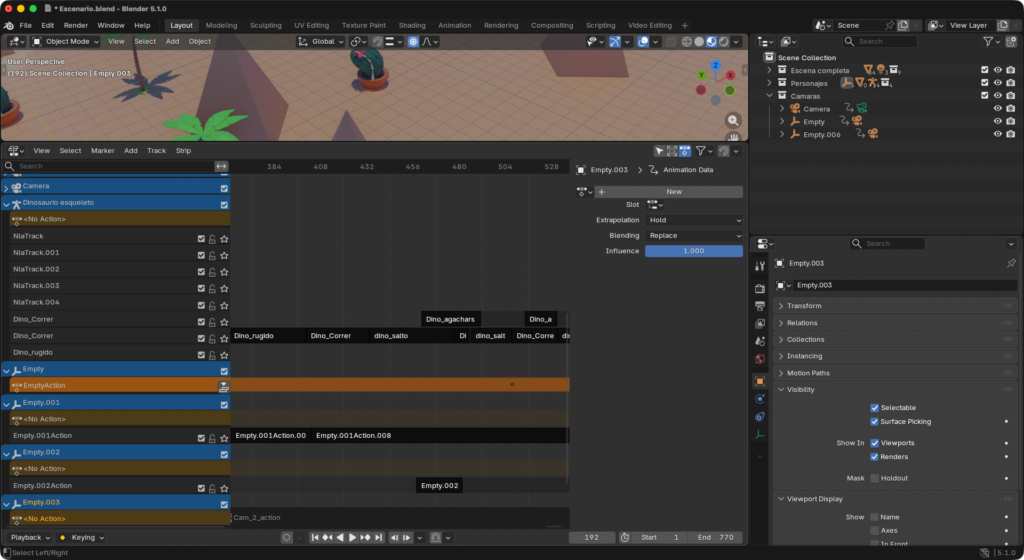

Cinematografía Computacional: Teoría de Lentes y Montaje Multi-Cámara 🎥

De nada sirve tener una gran animación física si la cámara no sabe contar la historia. Un plano fijo de 60 segundos es intolerable para el lapso de atención del espectador moderno. Inspirado en la teoría de cámaras y lentes del cine de Hollywood, configuré 3 cámaras virtuales (Shift + A > Camera), asignando a cada una un propósito psicológico y óptico distinto:

Plano Establecedor (Cámara 1):

Un plano general elevado, diseñado para ubicar al espectador en la vasta geografía del desierto. Para simular el vuelo de un dron con estabilizador gimbal, no animé la cámara directamente; la emparenté a un Empty ubicado en el centro del mapa y animé la rotación del Empty en el eje Z. Esto forzó a la cámara a orbitar el desierto en un círculo perfecto. En las propiedades de la lente, mantuve la Distancia Focal (Focal Length) en 50mm, el estándar de la industria que imita la compresión de la perspectiva del ojo humano.

Plano de Acción Adrenalínica (Cámara 2):

El objetivo aquí es inyectar velocidad y peligro. Emparenté esta cámara directamente al “vehículo Empty” del dinosaurio (el mismo que lo arrastraba por el mapa). El resultado algorítmico es que la cámara hereda instantáneamente la velocidad de 50 km/h del personaje, viajando paralela a él a escasos centímetros de la arena. Es el equivalente técnico a montar un camera car sobre rieles al lado de un actor. Para darle un toque de cinéma vérité y caos, animé la cámara sutilmente en su eje X local (lateral) acercándose y alejándose del dinosaurio violentamente para esquivar la colisión con los cactus.

Plano Épico de Despedida (Cámara 3):

Anclé esta cámara al suelo, estática, filmando desde el punto de partida original. Para generar una tensión emocional de cierre, apliqué la famosa técnica óptica del Dolly Zoom(también conocida como el Efecto Vértigo popularizado por Alfred Hitchcock). A medida que el modelo del dinosaurio se alejaba corriendo y reducía su tamaño en pantalla, animé agresivamente la distancia focal de la cámara desde los 50mm hasta los 100mm. En la teoría óptica, un teleobjetivo (100mm o más) comprime radicalmente la profundidad de campo y “aplasta” los planos de fondo contra el sujeto. El efecto visual resultante es que las gigantescas montañas del fondo parecen abalanzarse hacia la pantalla, engullendo la pequeña figura del dinosaurio mientras desaparece en la inmensidad.

El Montaje Automatizado (No Destructivo)

En lugar de la tediosa labor de renderizar estas tres tomas por separado en gigabytes de video para luego unirlas en Premiere Pro, utilicé la genial función interna de Blender: Bind Camera to Markers. En la línea de tiempo, coloqué Marcadores (M) en los fotogramas exactos donde los golpes de la percusión musical sugerían un corte visual (frames 1, 360, y 1080). Seleccionando cada cámara en el visor 3D y su respectivo marcador en la línea de tiempo, ejecuté el comando Ctrl + B. De esta forma, el visor Viewport de Blender actúa como un switcher (mezclador) de televisión en una sala de control en vivo, saltando el renderizado de un lente a otro de forma 100% automatizada.

Diseño Sonoro: Resolución de Contextos Globales y Sincronización 🎵

El cine es un arte audiovisual; la mitad del impacto reside en las ondas sonoras. La integración del audio en Blender se lleva a cabo en el espacio de trabajo especializado llamado Video Editing. Sin embargo, esta fase estuvo a punto de hacerme detener el proyecto por completo.

Al intentar importar mi archivo .mp3 desde el explorador, el menú desplegable de Blender me bloqueó con un mensaje de error renderizado en un intimidante texto rojo: "Disabled: Context missing sequencer scene". El botón estaba completamente deshabilitado, en gris.

La resolución de este bloqueo técnico me ayudó a comprender la profunda arquitectura de gestión de datos interna de Blender. El Editor Secuenciador de Video es un entorno algorítmico semi-independiente; necesita saber exactamente sobre qué “Escena 3D” (qué colección de luces, cámaras y objetos) está trabajando para sincronizar el código de tiempo. Al saltar rápidamente entre áreas de trabajo (Layout, Shading, Video Editing), el secuenciador había perdido ese “puntero de memoria”. La solución de ingeniería consistió en localizar el diminuto ícono de la claqueta en la cabecera superior del editor de video y volver a seleccionar explícitamente el bloque de datos de mi Scene principal.

Una vez restablecido el contexto de memoria, la opción revivió. Importé la pista de audio y utilicé la invaluable herramienta de Audio Scrubbing. Esta función procesa las muestras de audio (típicamente a 44.1kHz o 48kHz) en tiempo real conforme arrastras el cabezal de reproducción manualmente con el ratón. Esto me permitió realizar un montaje sincrónico milimétrico: ajusté los keyframes de mis cámaras para que cada corte de plano coincidiera exactamente con un cambio en los acordes de 8-bits de la melodía de Tetris.

El Jefe Final: Rasterización en Tiempo Real (Optimizando Eevee) 🖥️

La etapa terminal es la Exportación (Renderización), el exhaustivo proceso computacional donde semanas de cálculos matemáticos vectoriales se colapsan en píxeles RGB bidimensionales legibles para un reproductor de video. Blender ofrece dos titanes para esta labor: Cycles (un motor de Path Tracing puro que simula rebotes de fotones físicos reales) y Eevee (un motor de rasterización avanzado, similar al cerebro gráfico de Unreal Engine).

Hice una prueba de estrés renderizando un solo frame con Cycles. La asombrosa calidad de la iluminación global indirecta y las refracciones requerían, en mi hardware, un tiempo de computación de 45 segundos por fotograma. Multiplicado por 1440 fotogramas, la proyección matemática indicaba casi 18 horas de renderizado ininterrumpido a carga máxima, con el consecuente riesgo de estrangulamiento térmico (thermal throttling) de la CPU.

Uso y configuración del motor Eevee

Para salvar mi equipo, me cambié a Eevee. Eevee no dispara rayos de luz físicamente precisos; utiliza heurísticas y trucos matemáticos de aproximación (rasterización) para engañar al ojo humano. Para que el corto no se viera plano y plástico como un videojuego de principios del 2000, tuve que sobrecargar sus motores de post-procesamiento volumétrico en las propiedades de render:

- Ambient Occlusion (Oclusión Ambiental Computada): Los motores de rasterización no saben intrínsecamente calcular dónde y cómo se tocan dos geometrías. Activar el AO fuerza a Blender a escanear la profundidad de la pantalla y oscurecer algorítmicamente las grietas, pliegues y puntos de contacto (las sombras en la base de los cactus y debajo de los pies del dinosaurio en la arena). Esto ancla visualmente los objetos al mundo, dándoles densidad y peso físico real.

- Screen Space Reflections (Reflejos de Espacio de Pantalla – SSR): Obliga al motor a reciclar los píxeles RGB que ya han sido renderizados en la cámara para proyectarlos como reflejos falsos sobre las superficies rugosas, añadiendo micro-brillos sutiles a la arena y a las rocas circundantes.

- Bloom (Resplandor Bloom / Lens Flare Effect): El efecto posprocesado más vital para mi atmósfera. La función de Bloom escanea el fotograma en busca de los píxeles con valores de emisión lumínica superiores al umbral base (1.0). Al detectarlos (en este caso, mis chispas/partículas emisivas de la lámpara), aplica una matriz de convolución matemática (desenfoque gaussiano) que hace que el color “sangre” hacia los píxeles vecinos oscuros. Esto simula la imperfección óptica de una lente de cámara real saturándose por el exceso de fotones.

Con estos pesados filtros activos, el tiempo de computación en Eevee fue de apenas 1.5 segundos por fotograma.

Configuración de Output Properties:

Finalmente, abordé la sección de Output Properties. Es fundamental entender que Blender genera secuencias de imágenes silenciosas por diseño. Para integrar el audio en el archivo final, seleccioné el contenedor FFmpeg Video con codificación interna MPEG-4. Navegué a la subsección crítica y oculta de Audio y cambié el ajuste de No Audio al codificador AAC (Advanced Audio Coding). Presioné Ctrl + F12 (Render Animation) y dejé a los núcleos de mi procesador trabajar en armonía. En unos escasos 35 minutos, Eevee me entregó un archivo MP4 impecable de un minuto de duración, con video, luz, físicas y audio perfectamente entrelazados.

Conclusiones de esta Titánica Locura 🧠

Llevar a cabo la creación de un cortometraje animado desde un lienzo en blanco hasta un archivo de video final en Blender es un viaje pedagógico profundo. Desafía en igual medida la sensibilidad artística y el rigor del pensamiento algorítmico y matemático. El proceso inicia en la arquitectura de estructurar coordenadas de un entorno vasto descargado de Sketchfab, cruza el pantano técnico de aplicar la limpieza de matrices en el rigging de deformación (la purga de las escalas para evitar explosiones), hasta culminar en la orquestación suprema de cuaterniones de animación complejos mediante el editor jerárquico NLA.

La decisión de ingeniería de emular la locomoción empleando un Empty como “cinta de correr” resultó ser el salvavidas técnico absoluto para erradicar el foot sliding. A su vez, la dirección de un sistema multicámara fundamentado en la teoría de lentes clásica y longitudes focales (el salto de 50mm a 100mm del Dolly Zoom) elevó cualitativamente la producción, separándola del trabajo de un aficionado para rozar el montaje cinematográfico.

Por último, la parametrización minuciosa del motor rasterizador Eevee sentó un precedente empírico innegable: no es mandatario sacrificar días de vida útil de procesamiento en cálculos de Path Tracing fotorealista si el animador sabe dominar y “engañar” la percepción humana mediante herramientas algorítmicas de oclusión ambiental, resplandores volumétricos (bloom) y un montaje de diseño sonoro envolvente.

El software 3D, alguna vez elitista, ya no es el límite limitante de la industria creativa; la única y verdadera frontera restante es la perseverancia, la curiosidad y la resiliencia del artista para diagnosticar y resolver problemas de lógica computacional. ¡Nos leemos en el próximo render!

Fuentes 📚

Adobe Systems. (s.f.). Mixamo [Software de captura de movimiento e inteligencia artificial para rigging automático basado en la nube]. Recuperado de https://www.mixamo.com/

Design Factory. (2024). Low poly desert with animation(beautiful night) [Archivo de Modelo 3D con topología y texturas integradas]. Sketchfab. Recuperado de https://sketchfab.com/3d-models/low-poly-desert-with-animationbeautiful-night-58239e6a61b44cd19cae006a08710a9c

Gatito. (2024). Dinosaurio animable [Archivo de Modelo 3D con topología base en quads]. Sketchfab. Recuperado de https://sketchfab.com/3d-models/dinosaurio-animable-945067bc26e64440a77a1193075df5f0

Design Factory. (2024). Pajaroa [Archivo de Modelo 3D]. Sketchfab. Recuperado de https://sketchfab.com/3d-models/pajaroa-656065b84b9f497ab36bd7c44b310278

SINERGIA. (2024). Título del video de referencia 1 detallando teoría del montaje 3D[Archivo de Video]. YouTube. Recuperado de https://www.youtube.com/watch?v=rK3TtZc1S-4

SINERGIA. (2024). Título del video de referencia 2 sobre flujos de trabajo en animación digital [Archivo de Video]. YouTube. Recuperado de https://www.youtube.com/watch?v=VpcljaZwJyY

Marcel S. (2024). Video Musical / Banda Sonora (Original Tetris Theme Reference)[Archivo de Video y Composición de Audio]. YouTube. Recuperado de https://www.youtube.com/watch?v=NmCCQxVBfyM&list=PL_QwJrSTDx0WP2Es_fqNwelya7O-9krMg&index=82

Foundation, B. (2024). Blender 4.0 Reference Manual: Comprehensive Technical Documentation. Blender Foundation. https://docs.blender.org/manual/en/latest/

Autor:Andrés Camilo Plaza Jiménez.

Editor: Mg. Ing. Carlos Iván Pinzón Romero

Código: UCPI-2.

Universidad: Universidad Central.