Shaders procedurales para los escenarios dinámicos y generación de texturas y efectos visuales en tiempo real (GLSL/HLSL)

Historia de la Computación Gráfica: Shaders Procedurales para Escenarios Dinámicos y Generación de Texturas en Tiempo Real (GLSL/HLSL)

La computación gráfica ha experimentado un gran crecimiento desde mediados del siglo XX, impulsado por los avances en hardware y la introducción de nuevos lenguajes de programación. Entre ellos destacan los shaders, programas que se ejecutan directamente en la GPU y permiten controlar cómo se generan y procesan las imágenes con un alto nivel de realismo. Dentro de este campo, los shaders procedurales han adquirido un papel clave al generar texturas, escenarios y efectos visuales mediante algoritmos, sin necesidad de imágenes predefinidas. Lenguajes como GLSL (Khronos Group, s.f.) y HLSL (Novedge, 2024) se han convertido en herramientas fundamentales para el desarrollo de gráficos en tiempo real gracias a su flexibilidad, rendimiento y capacidad de adaptación a distintos entornos.

Video

¿Por qué GLSL y HLSL son pilares fundamentales?

Permiten control total del pipeline gráfico

GLSL fue creado para sustituir el uso de ensamblador con un lenguaje de alto nivel tipo C, facilitando el dominio sobre las etapas de vertex y fragment shaders. Al integrarse en OpenGL 2.0 en 2004, otorgó un control más directo y portable sobre la renderización.

HLSL nació con Direct3D 9 como alternativa de alto nivel al ensamblador, y se convirtió en obligatorio desde Direct3D 10, soportando múltiples tipos de shaders como vértice, fragmento (pixel), geometría, teselación, cómputo y ray tracing.

Compatibilidad y rendimiento optimizado

GLSL ofrece compatibilidad multiplataforma: funciona en Windows, macOS, Linux y consolas, y cada fabricante incorpora en el driver un compilador optimizado para su hardware.

HLSL, por su parte, es altamente estable y está profundamente integrado con el ecosistema DirectX, lo que lo vuelve ideal para desarrollo en plataformas Microsoft.

Flexibilidad, expresividad y herramientas avanzadas

HLSL incluye características avanzadas como #include, namespaces, operadores sobrecargables y plantillas (templates), lo que permite escribir shaders más modulables y mantenibles.

Facilitan el desarrollo multiplataforma

Gracias a SPIRV (Standard Portable Intermediate Representation), tanto GLSL como HLSL pueden compilarse a un formato intermedio que permite interoperar entre Vulkan, OpenGL, WebGPU, e incluso entre sí. Esto mejora la portabilidad y reduce complejidad en proyectos multiplataforma.

Nacimiento y consolidación de GLSL y HLSL

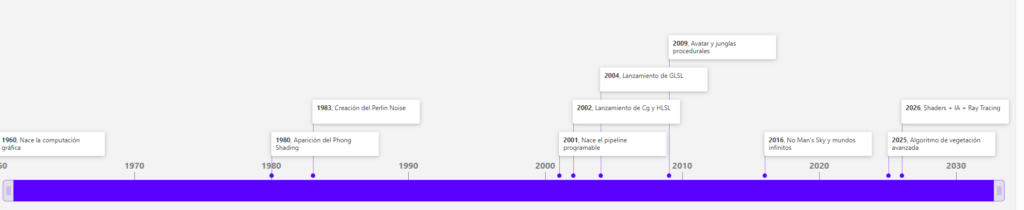

Al principio, programar shaders requería escribir instrucciones en ensamblador, un proceso complejo y poco accesible. Para simplificarlo, se desarrollaron lenguajes de alto nivel. En 2002, Nvidia y Microsoft lanzaron Cg (C for Graphics) y HLSL (High-Level Shader Language) para Direct3D, que adoptaban una sintaxis similar a C.

En paralelo, el grupo Khronos desarrolló GLSL (OpenGL Shading Language), incluido oficialmente en OpenGL 2.0 en 2004. GLSL permitió a los desarrolladores escribir vertex y fragment shaders directamente en un lenguaje portátil y multiplataforma, eliminando la dependencia del ensamblador y facilitando la adopción masiva de shaders en videojuegos y aplicaciones gráficas.

Mientras HLSL está estrechamente ligado a DirectX y al ecosistema Windows, GLSL es el estándar abierto para OpenGL y Vulkan, usado en sistemas multiplataforma, consolas y entornos de desarrollo independientes.

Historia y evolución de los shaders

En sus primeras décadas, la computación gráfica funcionaba bajo un modelo conocido como tubería fija (fixed function pipeline). Este sistema ofrecía un conjunto limitado de funciones preprogramadas que los desarrolladores podían activar o desactivar, pero sin la posibilidad de personalizar el flujo de renderizado. Esto significaba que, aunque se podían mostrar imágenes en 3D con iluminación y texturas, no existía control directo sobre el cálculo de cada píxel o vértice.

El cambio comenzó a gestarse en la década de 1980 con investigaciones como el Phong Shading, desarrollado por Bui Tuong Phong, que introdujo técnicas de interpolación para simular reflejos especulares de forma más realista. Sin embargo, no fue hasta principios de los 2000 que la industria dio un salto decisivo con la llegada del pipeline programable. NVIDIA, con su tarjeta GeForce 3 en 2001, introdujo los primeros vertex shaders y pixel shaders programables, lo que permitió que los desarrolladores escribieran código para manipular directamente cómo se dibujaban los gráficos.

Este avance marcó un hito: por primera vez, los artistas y programadores podían definir matemáticamente cómo se comportaban la luz, las sombras, las texturas y los colores en un entorno tridimensional.

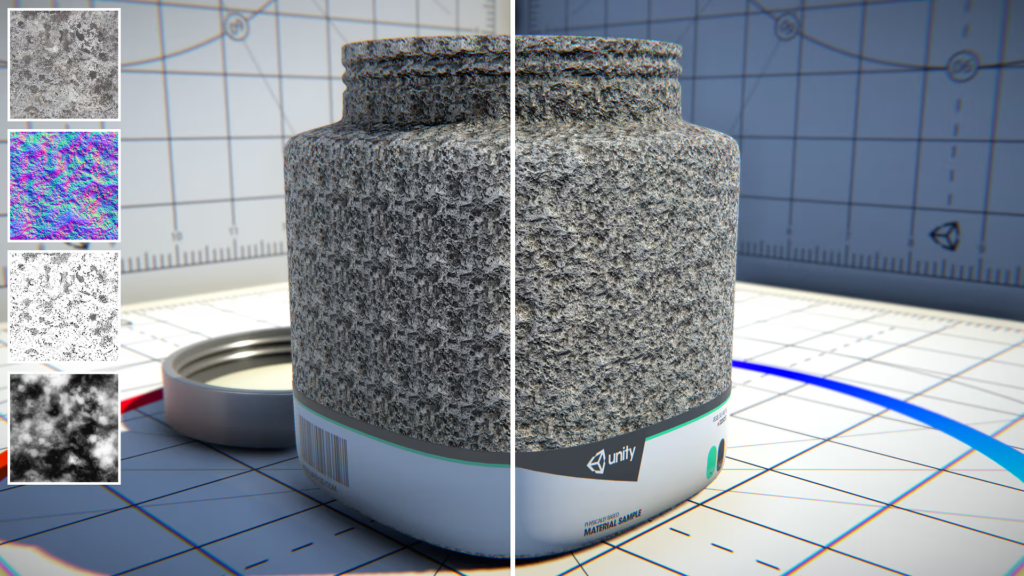

Proceduralidad: generación algorítmica de texturas y escenarios

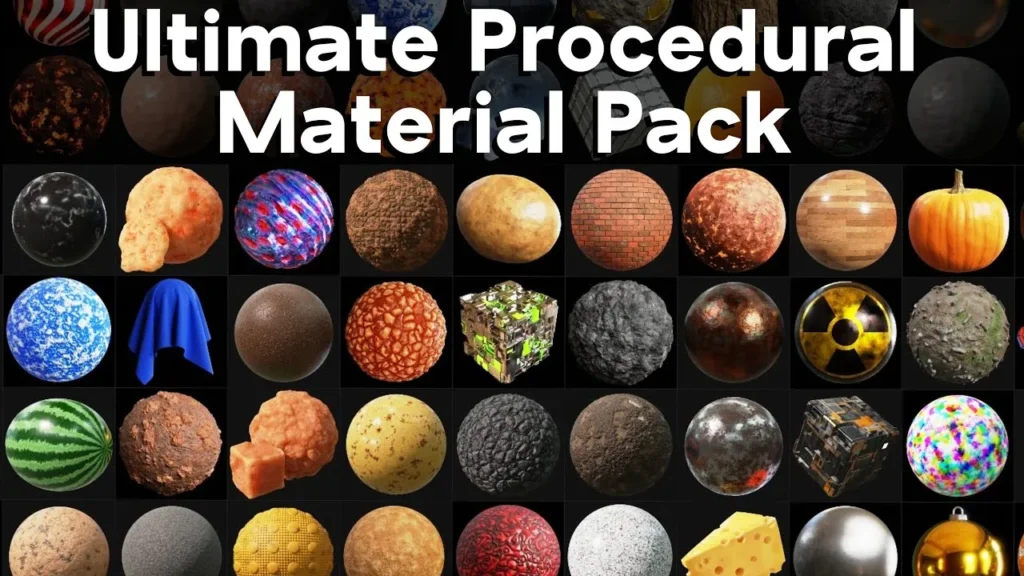

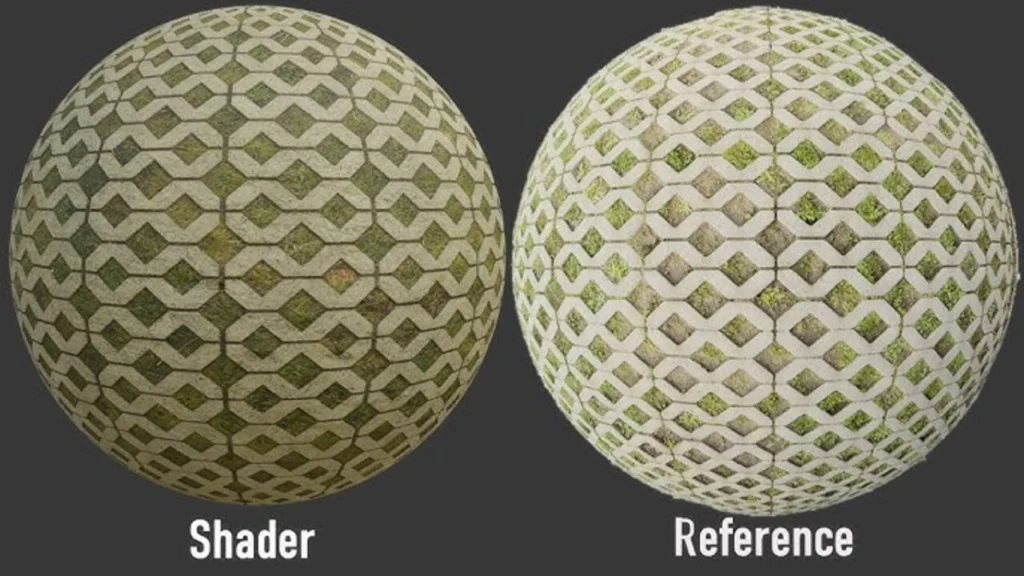

Los shaders procedurales se diferencian de los tradicionales en que no dependen de imágenes preexistentes (bitmaps) para aplicar texturas o patrones, sino que los generan mediante funciones matemáticas. Esta técnica ofrece ventajas notables:

- Resolución infinita: al no depender de imágenes fijas, pueden escalarse sin pérdida de calidad.

- Bajo consumo de memoria: solo se almacena el algoritmo, no el archivo de imagen.

- Variabilidad infinita: un mismo algoritmo puede generar infinitas variaciones modificando parámetros.

Uno de los ejemplos más emblemáticos es el Perlin Noise, creado por Ken Perlin en 1983 para simular patrones naturales como nubes, fuego o superficies rugosas. Esta técnica fue utilizada en películas como Tron y posteriormente se integró en videojuegos y simuladores. A partir de ahí, se desarrollaron otros métodos como Simplex Noise, Worley Noise y funciones fractales para lograr materiales más complejos.

En escenarios dinámicos, los shaders procedurales permiten que el mundo virtual reaccione en tiempo real a cambios en el clima, iluminación o acciones del jugador, generando paisajes que evolucionan de forma orgánica sin necesidad de predefinir cada detalle.

Ejemplos prácticos en cine y videojuegos

En la industria cinematográfica, los shaders procedurales han sido clave para la creación de entornos complejos y realistas. Películas como Avatar (2009) utilizaron técnicas avanzadas de generación procedural para crear junglas y criaturas con texturas vivas y detalladas. En The Matrix Reloaded, los efectos de lluvia y reflejos fueron posibles gracias a shaders programables que controlaban cada interacción de luz en tiempo real.

En los videojuegos, títulos como Doom 3 y Crysis marcaron un antes y un después en la iluminación dinámica y el uso de normal maps generados por shaders. Más recientemente, No Man’s Sky llevó la proceduralidad a un nuevo nivel, generando planetas enteros, ecosistemas, fauna y clima a partir de un conjunto reducido de datos iniciales, todo en tiempo real.

Tendencias actuales y futuro de los shaders procedurales

La evolución de los shaders procedurales está estrechamente ligada a los avances en hardware y a nuevas tecnologías como el ray tracing en tiempo real. Hoy en día, tarjetas gráficas modernas pueden combinar shaders tradicionales con trazado de rayos para lograr iluminación y reflejos extremadamente realistas.

En 2025, investigadores de la Universidad de Coburg junto con AMD desarrollaron un algoritmo capaz de generar 35,6 GB de vegetación desde solo 52 KB de datos, usando técnicas avanzadas en GPU conocidas como work graphs. Este logro demuestra que la generación procedural seguirá reduciendo la necesidad de almacenar grandes volúmenes de datos gráficos.

Además, se vislumbra un futuro en el que la inteligencia artificial se integre con shaders procedurales para generar entornos adaptativos que respondan al comportamiento del usuario, abriendo posibilidades para experiencias más inmersivas y personalizadas.

Conclusión

La historia y evolución de la computación gráfica refleja un camino de innovación constante, donde la transición desde la tubería fija hacia el pipeline programable marcó un punto de inflexión que permitió un control sin precedentes sobre el proceso de renderizado. En este contexto, lenguajes como GLSL y HLSL han sido determinantes, ya que no solo reemplazaron la complejidad del ensamblador con sintaxis de alto nivel más accesible, sino que también brindaron a desarrolladores y artistas una herramienta versátil para manipular cada etapa del procesamiento gráfico. GLSL, como estándar abierto, garantiza portabilidad y soporte multiplataforma, mientras que HLSL, profundamente integrado con DirectX, ofrece un rendimiento optimizado en entornos Windows y características avanzadas que favorecen la modularidad y el mantenimiento del código.

La introducción y consolidación de los shaders procedurales ha transformado radicalmente la manera en que se generan texturas y escenarios. A través de algoritmos matemáticos capaces de producir materiales y entornos en tiempo real, se ha conseguido reducir el consumo de memoria, eliminar la dependencia de imágenes predefinidas y lograr una variabilidad prácticamente infinita. Estas capacidades han permitido que entornos virtuales reaccionen dinámicamente a factores como el clima, la iluminación o la interacción del usuario, dotando de mayor realismo y dinamismo a películas, simuladores y videojuegos. Producciones cinematográficas como Avatar o videojuegos como No Man’s Sky demuestran cómo la proceduralidad y los shaders programables pueden crear mundos inmersivos de gran escala sin comprometer el rendimiento.

Mirando hacia el futuro, la convergencia entre shaders procedurales, ray tracing en tiempo real y técnicas de inteligencia artificial plantea un escenario en el que los entornos gráficos no solo serán más realistas, sino también adaptativos, capaces de modificar su apariencia y comportamiento en función de las acciones del usuario o de condiciones definidas por el propio sistema. Los avances recientes, como el desarrollo de algoritmos que generan decenas de gigabytes de geometría y texturas a partir de kilobytes de datos, confirman que la tendencia será hacia entornos cada vez más ricos, optimizados y flexibles.

De esta manera, la relevancia de GLSL y HLSL trasciende su función como simples lenguajes de programación de shaders: se han convertido en catalizadores de una nueva era en la computación gráfica, donde la creatividad y la técnica convergen para dar forma a experiencias visuales que antes solo podían imaginarse.

TimeToast

Créditos

Autor: Nicolas Fonseca Fagua

Editor: Mg Carlos Iván Pinzón Romero

Código: CG-20252

Fuentes:

Alain Galván. (2022, febrero 12). A Review of Shader Languages. https://alain.xyz/blog/a-review-of-shader-languages

Alain Galván. (2022, febrero 12). A Review of Shader Languages. https://alain.xyz/blog/a-review-of-shader-languages

fxphd. (2014). Procedural Layer Shader Techniques in Cinema 4D [Imagen]. fxphd.com. https://www.fxphd.com/details/471/

GM Designer. (c. 2020). Procedural Shader – 4.2+ [Paquete de shaders procedurales para Blender]. Superhive Market.

https://superhivemarket.com/products/procedural-shaders-pacote

Heitz, E., & Deliot, T. (2019, 14 de febrero). Procedural stochastic texturing in Unity [Entrada de blog]. Unity. https://unity.com/blog/engine-platform/procedural-stochastic-texturing-in-unity

King, R. (s. f.). Ultimate Blender Procedural Material Pack [FAQ]. Superhive Market. https://superhivemarket.com/products/ultimate-materials/faq

NVIDIA. (2023). Developer Blog. NVIDIA Corporation. https://developer.nvidia.com/

Perlin, K. (1985). An image synthesizer. ACM SIGGRAPH Computer Graphics, 19(3), 287–296. https://doi.org/10.1145/325165.325247

Shadertoy. (s.f.). Shadertoy: Build and Share your best Shaders. https://www.shadertoy.com/

TimeToast https://www.timetoast.com/timelines/3189005

University of Coburg & AMD. (2025). Procedural vegetation generation using work graphs. AMD GPUOpen. https://gpuopen.com/

YouTube. (2019). Intro to Shaders & the Graphics Pipeline [Video]. YouTube. https://www.youtube.com/watch?v=gMtQaTH29No